Si desea desarrollar una aplicación de IA generativa, puede utilizar GitHub Models para buscar y experimentar gratis con modelos de inteligencia artificial. Una vez que estés a punto para llevar la aplicación a producción, opta por el uso de pago para tu empresa.

Los propietarios de la organización pueden integrar sus modelos personalizados preferidos en GitHub Models, mediante claves de API de LLM propias de una organización. Consulta Uso de sus propias claves de API en modelos de GitHub.

Consulta también Utilización responsable de los modelos de GitHub.

Búsqueda de modelos de IA

Para buscar un modelo de IA:

-

Haz clic en Model: Select a Model en la parte superior izquierda de la página.

-

Elige un modelo en el menú desplegable.

Como alternativa, en el menú desplegable, haz clic en View all models, haz clic en un modelo en Marketplace y, a continuación, en Playground.

El modelo se abre en el sitio de prueba del modelo. Los detalles del modelo se muestran en la barra lateral de la derecha. Si no se muestra la barra lateral, expándela haciendo clic en el icono situado a la derecha del sitio de prueba.

Nota:

El acceso a los modelos de OpenAI está actualmente en fase de vista previa pública y está sujeto a cambios.

Experimentos con modelos de IA en el área de juegos

El sitio de prueba del modelo de IA es un recurso gratuito que permite ajustar los parámetros del modelo y enviar indicaciones para ver cómo responde un modelo.

Nota:

- La zona de ensayo está en versión preliminar pública y está sujeta a cambios.

- El área de juegos tiene limitación de tasa. Veáse los límites de tasa a continuación.

Para ajustar los parámetros del modelo en el sitio de prueba, selecciona la pestaña Parameters en la barra lateral.

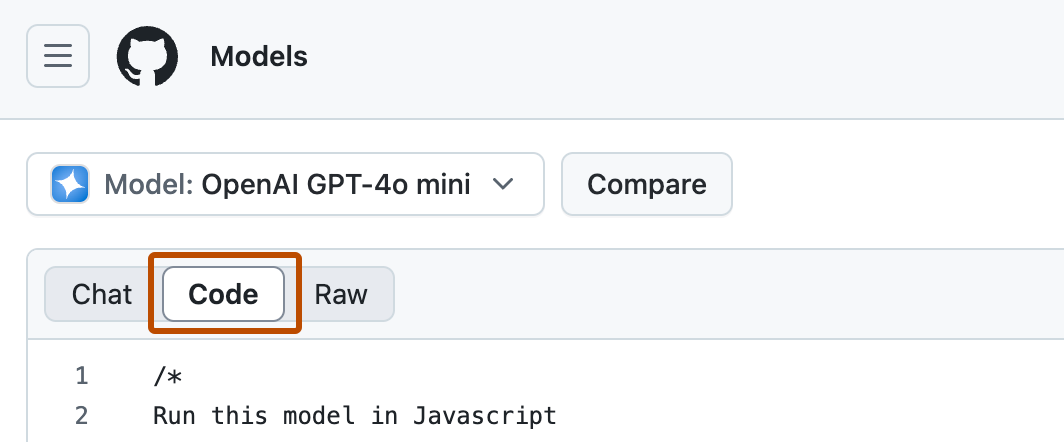

Para ver el código que corresponde a los parámetros que haya seleccionado, cambie de la pestaña Chat a la pestaña Código.

Comparación de modelos

Puedes enviar una solicitud a dos modelos al mismo tiempo y comparar las respuestas.

Con un modelo abierto en el sitio de prueba, haz clic en Compare y, a continuación, en el menú desplegable, selecciona un modelo para la comparación. El modelo seleccionado se abre en una segunda ventana de chat. Al escribir un indicador en cualquier ventana de chat, el mensaje se espeja en la otra ventana. Las solicitudes se envían simultáneamente para poder comparar las respuestas de cada modelo.

Todos los parámetros que establezcas se usan para ambos modelos.

Evaluación de modelos de IA

Una vez que hayas iniciado las solicitudes de prueba en el área de juegos, puedes evaluar el rendimiento del modelo mediante métricas estructuradas. Las evaluaciones te ayudan a comparar varias configuraciones de indicaciones en distintos modelos y determinar qué configuración funciona mejor.

En la vista Comparaciones, puedes aplicar evaluadores como similitud, relevancia y fundamento para medir el grado de cumplimiento de cada resultado. También puedes definir tus propios criterios de evaluación con un evaluador de indicaciones personalizado.

Para obtener instrucciones paso a paso, consulta Evaluación de salidas.

Experimentos con modelos de IA mediante la API

Nota:

El uso gratuito de la API se encuentra en la fase de versión preliminar pública y está sujeto a cambios.

GitHub proporciona una utilización gratis de la API para que pueda experimentar con modelos de IA en su propia aplicación.

Los pasos para utilizar cada modelo son similares. En términos generales, necesitarás:

-

Haz clic en Model: Select a Model en la parte superior izquierda de la página.

-

Elige un modelo en el menú desplegable.

Como alternativa, en el menú desplegable, haz clic en View all models, haz clic en un modelo en Marketplace y, a continuación, en Playground.

El modelo se abre en el entorno de prueba del modelo.

-

Haz clic en la pestaña Code.

-

De manera opcional, puede utilizar una lista desplegable para seleccionar el lenguaje de programación.

-

De forma igualmente opcional, utilice la lista desplegable SDK para seleccionar qué SDK se va a usar.

Todos los modelos se pueden usar con el SDK de inferencia de Azure AI y algunos modelos admiten SDK adicionales. Si quieres cambiar fácilmente entre modelos, debes seleccionar "Azure AI Inference SDK". Si seleccionó "REST" como lenguaje, no utilizará un SDK. En su lugar, usará el punto de conexión de API directamente.

-

Abra un codespace o configure el entorno local:

- Para ejecutarse en un codespace, haz clic en Run codespace y, a continuación, haz clic en Create new codespace.

- Ejecución en modo local:

- Cree un GitHub personal access token. El token debe tener permisos de

models:read. Consulta Administración de tokens de acceso personal. - Guarde el token como una variable de entorno.

- Instale las dependencias del SDK, si es necesario.

- Cree un GitHub personal access token. El token debe tener permisos de

-

Utilice el código de ejemplo para realizar una solicitud al modelo.

La utilización gratuita de la API está sujeta a limitaciones de uso. Veáse los límites de tasa a continuación.

Almacenamiento y uso compartido de los experimentos del área de juegos

Puedes guardar y compartir tu progreso en el área de juegos con valores preestablecidos. Los valores preestablecidos guardan:

- Tu estado actual

- Tus parámetros

- Tu historial de chat (opcional)

Para crear un valor preestablecido para el contexto actual, selecciona Preset: PRESET-NAME en la parte superior del sitio de prueba y, a continuación, haz clic en Crear nuevo valor preestablecido. Debes asignar un nombre al valor preestablecido y también puedes optar por proporcionar una descripción del mismo, incluir el historial de chat y permitir que el valor preestablecido se comparta.

Hay dos maneras de cargar un valor preestablecido:

- Selecciona el menú desplegable Preset: PRESET-NAME , luego haz clic en el preset que deseas cargar.

- Abre una URL de ajuste preestablecido compartido

Después de cargar un valor preestablecido, puedes editarlo, compartirlo o eliminarlo:

- Para editar el valor preestablecido, cambia los parámetros y pregunta al modelo. Una vez que estés satisfecho con los cambios, selecciona el menú desplegable Preset: PRESET-NAME y, a continuación, haz clic en Edit preset y guarda las actualizaciones.

- Para compartir el valor preestablecido, selecciona el menú desplegable Preset: PRESET-NAME y, a continuación, haz clic en Compartir valor preestablecido para obtener una dirección URL que se pueda compartir.

- Para eliminar el valor preestablecido, selecciona el menú desplegable Preset: PRESET-NAME y, a continuación, haz clic en Delete preset y confirma la eliminación.

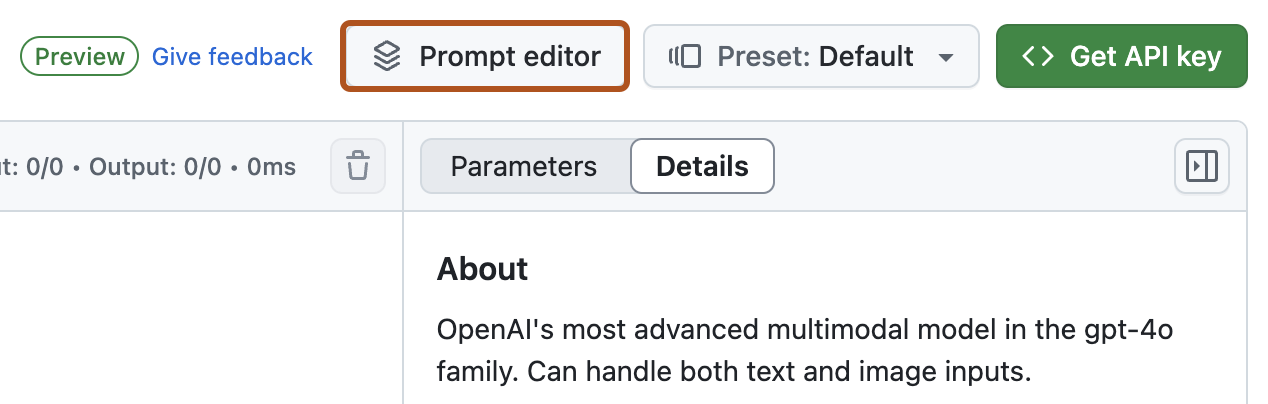

Uso del editor de indicaciones

El editor de indicaciones de GitHub Models está diseñado para ayudarte a iterar, refinar y perfeccionar tus indicaciones. Esta vista dedicada proporciona una experiencia centrada e intuitiva para crear y probar datos de entrada, permitiéndole:

- Probar y refinar rápidamente las solicitudes sin la complejidad de las interacciones de varios turnos.

- Afinar las indicaciones para lograr precisión y relevancia en los proyectos.

- Use un espacio especializado para escenarios de un solo turno para garantizar resultados coherentes y optimizados.

Para acceder al editor de solicitudes, haz clic en Prompt editor en la parte superior derecha del área de juegos.

Experimentación con modelos de IA en Visual Studio Code

Nota:

La extensión del kit de herramientas de IA para Visual Studio Code se encuentra en versión preliminar pública y está sujeta a cambios.

Si prefieres experimentar con modelos de IA en el IDE, puedes instalar la extensión del kit de herramientas de IA para Visual Studio Code y, a continuación, probar modelos con parámetros ajustables y contexto.

-

En Visual Studio Code, instala la versión preliminar del kit de herramientas de AI para Visual Studio Code.

-

Para abrir la extensión, haz clic en el icono del kit de herramientas de IA en la barra de actividades.

-

Autoriza al kit de herramientas de IA a conectarse a tu cuenta de GitHub.

-

En la sección "Mis modelos" del panel Kit de herramientas de IA, haz clic en Open Model Catalog y, a continuación, busca un modelo con el que experimentar.

- Para usar un modelo alojado de forma remota a través de GitHub Models, en la tarjeta del modelo, haz clic en Probar en el área de pruebas.

- Para descargar y usar un modelo localmente, en la tarjeta de modelo, haz clic en Download. Una vez completada la descarga, en la misma tarjeta de modelo, haz clic en Cargar en el entorno de pruebas.

-

En la barra lateral, proporciona las instrucciones de contexto y los parámetros de inferencia para el modelo y, a continuación, envía un mensaje.

Pasar a producción

Los límites de tarifas gratuitas proporcionados en el área de juegos y el uso de la API están diseñados para ayudarte a empezar a experimentar. Cuando estés a punto para ir más allá de la oferta gratuita, tienes dos opciones para acceder a los modelos de IA diferentes de los límites gratuitos:

- Puedes optar por el uso de pago para GitHub Models, lo que permite a tu organización acceder a mayores límites de frecuencia, ventanas de contexto más grandes y características adicionales. Consulta Facturación de modelos de GitHub.

- Si tienes una suscripción de OpenAI o Azure existente, puedes traer tus propias claves de API (BYOK) para acceder a modelos personalizados. La facturación y el uso se administran directamente mediante tu cuenta de proveedor, como el id. de suscripción de Azure. Consulta Uso de sus propias claves de API en modelos de GitHub.

Límites de velocidad

Nota:

Una vez que optes por el uso de pago, tendrás acceso a los límites de tasa de nivel de producción y se te facturará por todo el uso a partir de entonces. Para más información sobre estos límites de velocidad, consulte Cuotas y límites de modelos de Microsoft Foundry en la documentación de Azure.

La utilización de la zona de pruebas y el uso gratuito de la API están sujetos a una limitación de tasa que se aplica por solicitudes por minuto, por día, tokens por solicitud y solicitudes simultáneas. Si alcanza un límite de tasa, tendrá que esperar a que dicho límite se restablezca antes de poder realizar más solicitudes.

Los modelos bajos, altos y de inserción tienen diferentes límites de velocidad. Para averiguar qué tipo de modelo está utilizando, consulte la información del modelo en GitHub Marketplace.

Para los modelos personalizados a los que se accede con tus propias claves de API, el proveedor de modelos establece y aplica los límites de velocidad.

| Nivel de límite de tasa | Límites de velocidad | Copilot Gratis | Copilot Pro | Copilot Business | Copilot Enterprise |

|---|---|---|---|---|---|

| Baja | Solicitudes por minuto | 15 | 15 | 15 | 20 |

| Solicitudes por día | 150 | 150 | 300 | 450 | |

| Tokens por solicitud | 8000 entrada, 4000 salida | 8000 entrada, 4000 salida | 8000 entrada, 4000 salida | 8000 entrada, 8000 salida | |

| Solicitudes simultáneas | 5 | 5 | 5 | 8 | |

| Alta | Solicitudes por minuto | 10 | 10 | 10 | 15 |

| Solicitudes por día | 50 | 50 | 100 | 150 | |

| Fichas por solicitud | 8000 entrada, 4000 salida | 8000 entrada, 4000 salida | 8000 entrada, 4000 salida | 16 000 entrada, 8000 salida | |

| Solicitudes simultáneas | 2 | 2 | 2 | 4 | |

| Embedding | Solicitudes por minuto | 15 | 15 | 15 | 20 |

| Solicitudes por día | 150 | 150 | 300 | 450 | |

| Tokens por solicitud | 64000 | 64000 | 64000 | 64000 | |

| Solicitudes simultáneas | 5 | 5 | 5 | 8 | |

| Versión preliminar o1 de Azure OpenAI | Solicitudes por minuto | No aplicable | 1 | 2 | 2 |

| Solicitudes por día | No aplicable | 8 | 10 | 12 | |

| Tokens por solicitud | No aplicable | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | 4000 entrada, 8000 salida | |

| Solicitudes simultáneas | No aplicable | 1 | 1 | 1 | |

| Azure OpenAI o1, o3 y gpt-5 | Solicitudes por minuto | No aplicable | 1 | 2 | 2 |

| Solicitudes por día | No aplicable | 8 | 10 | 12 | |

| Tokens por solicitud | No aplicable | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | 4000 entrada, 8000 salida | |

| Solicitudes simultáneas | No aplicable | 1 | 1 | 1 | |

| Azure OpenAI o1-mini, o3-mini, o4-mini, gpt-5-mini, gpt-5-nano y gpt-5-chat | Solicitudes por minuto | No aplicable | 2 | 3 | 3 |

| Solicitudes por día | No aplicable | 12 | 15 | 20 | |

| Tokens por solicitud | No aplicable | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | |

| Solicitudes simultáneas | No aplicable | 1 | 1 | 1 | |

| DeepSeek-R1, DeepSeek-R1-0528 y MAI-DS-R1 | Solicitudes por minuto | 1 | 1 | 2 | 2 |

| Solicitudes por día | 8 | 8 | 10 | 12 | |

| Tokens por solicitud | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | |

| Solicitudes simultáneas | 1 | 1 | 1 | 1 | |

| xAI Grok-3 | Solicitudes por minuto | 1 | 1 | 2 | 2 |

| Solicitudes por día | 15 | 15 | 20 | 30 | |

| Tokens por solicitud | 4000 entrada, 4000 salida | 4000 entrada, 4000 salida | 4000 entrada, 8000 salida | 4000 entrada, 16000 salida | |

| Solicitudes simultáneas | 1 | 1 | 1 | 1 | |

| xAI Grok-3-Mini | Solicitudes por minuto | 2 | 2 | 3 | 3 |

| Solicitudes por día | 30 | 30 | 40 | 50 | |

| Tokens por solicitud | 4000 entrada, 8000 salida | 4000 entrada, 8000 salida | 4000 entrada, 12000 salida | 4000 entrada, 12000 salida | |

| Solicitudes simultáneas | 1 | 1 | 1 | 1 |

Estos límites están sujetos a cambios sin previo aviso.

Escribir comentarios

Para formular preguntas y compartir comentarios, consulta esta entrada de debate sobre Modelos de GitHub. Para obtener información sobre cómo otros usan GitHub Models, visita los debates de la comunidad de GitHub para Modelos.